Sitemap là một file XML liệt kê các URL quan trọng của website. Bot đọc sitemap để phát hiện URL, sau đó quyết định crawl và có thể index. Mọi website đều muốn Google index nhanh và index đủ. Nhiều người bắt đầu bằng việc “submit sitemap”, rồi thất vọng vì số trang indexed vẫn thấp. Lý do thường không nằm ở thao tác submit, mà nằm ở chất lượng sitemap và chất lượng “URL inventory” mà sitemap đang đại diện. Bài viết này sẽ giải thích cho bạn hiểu sitemap là gì và tiêu chuẩn sitemap kỹ thuật SEO mới.

Sitemap chuẩn SEO kỹ thuật trông như thế nào

Sitemap XML rút ngắn thời gian khám phá (discovery time) của Googlebot đối với các URL mới xuất bản và các trang nằm sâu trong cấu trúc website. Đồng thời, tệp tin này cung cấp dữ liệu chẩn đoán trực tiếp trên Google Search Console, cho phép quản trị viên phát hiện các lỗi thu thập dữ liệu khi SEO và thiết kế website.

Cần lưu ý, Sitemap chỉ đóng vai trò là tín hiệu gợi ý (hint), nó không phải là chỉ thị bắt buộc (directive) ép Google phải lập chỉ mục 100% URL được gửi. Nếu trang mỏng nội dung, trùng lặp, hoặc bị Google đánh giá thấp về giá trị tìm kiếm, URL có thể không được index dù nằm trong sitemap. Sitemap cũng không phải công cụ để xin ưu tiên bằng priority hay changefreq.

Sitemap cũng không thay được liên kết nội bộ. Một trang nằm trong sitemap nhưng không có internal link tốt vẫn có thể bị Google coi là ít quan trọng hoặc khó hiểu về ngữ cảnh.

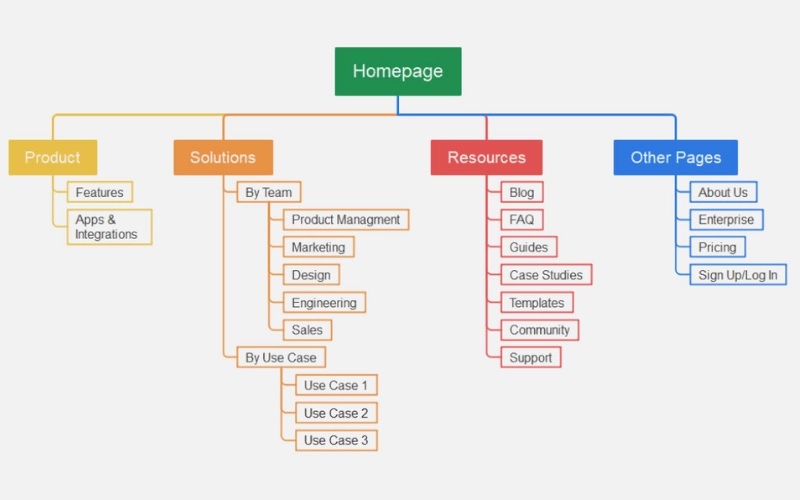

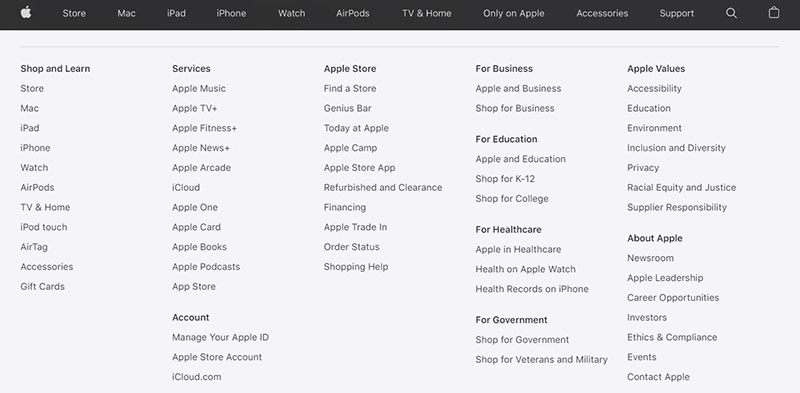

Phân biệt XML sitemap vs HTML sitemap

Về cơ bản, XML Sitemap là ngôn ngữ dành cho Crawler của các công cụ tìm kiếm, trong khi HTML Sitemap là giao diện điều hướng dành cho người dùng.

Hầu hết các SEOer bỏ qua HTML Sitemap vì cho rằng nó lỗi thời. Tuy nhiên, đối với các website thương mại điện tử (E-commerce) quy mô lớn, việc thiết lập một HTML Sitemap thông minh tại Footer sẽ điều hướng trực tiếp luồng sức mạnh liên kết (Link Equity / PageRank) đến các danh mục ngách (Sub-categories) đang bị mồ côi (orphan pages).

Điều này gián tiếp ép Googlebot phải cào lại các trang sâu mà không cần phụ thuộc hoàn toàn vào XML sitemap.

Cách chọn URL đưa vào sitemap

Một sitemap đúng chỉ nên chứa URL indexable và canonical mà bạn muốn Google index và có khả năng index về mặt kỹ thuật.

- Nên có: URL trả HTTP 200, là canonical, không bị chặn bởi robots.txt, không gắn noindex, và có giá trị tìm kiếm hoặc giá trị kinh doanh rõ ràng.

- Không nên có: URL redirect (3xx), URL 404/410, URL 5xx, trang bị noindex, URL bị chặn crawl trong robots.txt, URL tham số lọc/sort vô hạn, URL tracking (UTM), trang tìm kiếm nội bộ.

Nghe có vẻ hiển nhiên, nhưng đây là lỗi phổ biến nhất của sitemap “tự sinh” trên các website lớn: hệ thống tạo ra nhiều biến thể URL, rồi sitemap gom hết vào. Kết quả là Googlebot phải tiêu thời gian crawl các URL không đáng crawl, trong khi các trang quan trọng lại bị chậm index.

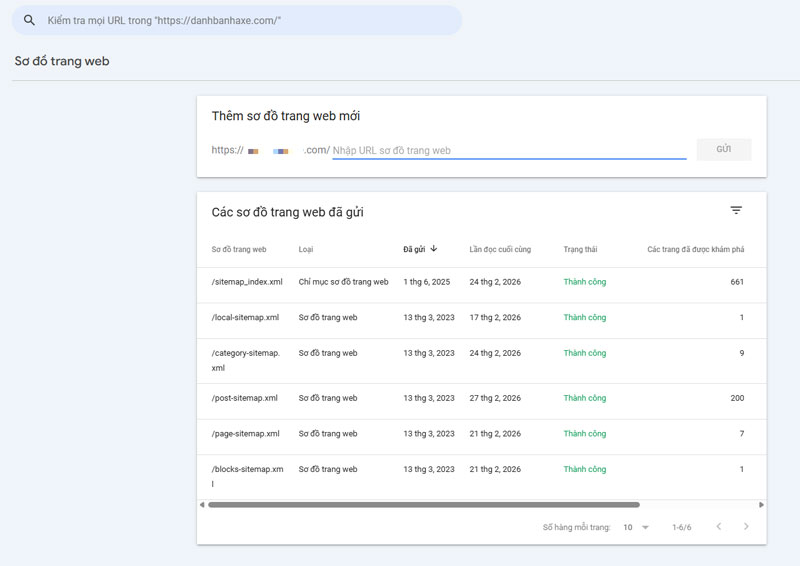

Đối với các site lớn, nên chia theo loại trang thường cho hiệu quả quản trị tốt: product-sitemap, category-sitemap, blog-sitemap. Khi tỷ lệ indexed giảm, nhìn theo từng nhóm sẽ biết nhóm nào đang gặp vấn đề.

Nhiều website còn chia theo độ mới: sitemap cho URL mới/cập nhật gần đây, sitemap cho kho URL cũ ổn định. Cách này giúp theo dõi “fresh index” tốt hơn, miễn là không dùng nó để che giấu chất lượng URL.

lastmod dùng thế nào để Google tin

lastmod là ngày cập nhật gần nhất của URL. Cách dùng lastmod hợp lý là cập nhật khi có thay đổi đáng kể: nội dung chính, dữ liệu quan trọng, hoặc những cập nhật thực sự làm trang khác đi ở góc nhìn người tìm kiếm. Thay đổi vụn vặt như sửa khoảng trắng, cập nhật copyright, hoặc thay layout không liên quan nội dung thường không đáng để “đẩy lastmod”.

Với site tin tức hoặc site cập nhật liên tục, lastmod càng cần kỷ luật. Nếu muốn ưu tiên recrawl các bài mới, cách tốt hơn là tách sitemap theo nhóm “fresh” và giữ lastmod trung thực, thay vì “dán ngày hôm nay” cho toàn bộ kho bài.

Theo tài liệu Google Search Central (Cập nhật tháng 6/2023), Google đã chính thức xác nhận: “Chúng tôi sử dụng giá trị <lastmod> nếu giá trị này nhất quán và có thể xác minh là chính xác. Nếu chúng tôi phát hiện thẻ này bị thao túng (ví dụ: cập nhật ngày giờ nhưng nội dung không đổi), Googlebot sẽ phớt lờ hoàn toàn tín hiệu này”. Do đó, kỷ luật trong việc khai báo lastmod là yếu tố sống còn để duy trì độ tin cậy của Sitemap.

Checklist kiểm tra sitemap để tăng tỷ lệ indexed trong Google Search Console

Việc dọn dẹp Sitemap không chỉ là lý thuyết. Theo báo cáo kỹ thuật từ Search Engine Journal, đối với các trang web lớn, việc loại bỏ 30% các URL rác (URL 404, chuỗi redirect, trang mỏng) khỏi Sitemap có thể giúp tăng tốc độ thu thập dữ liệu (Crawl Rate) lên tới 40% cho các trang sản phẩm cốt lõi chỉ trong vòng 14 ngày.

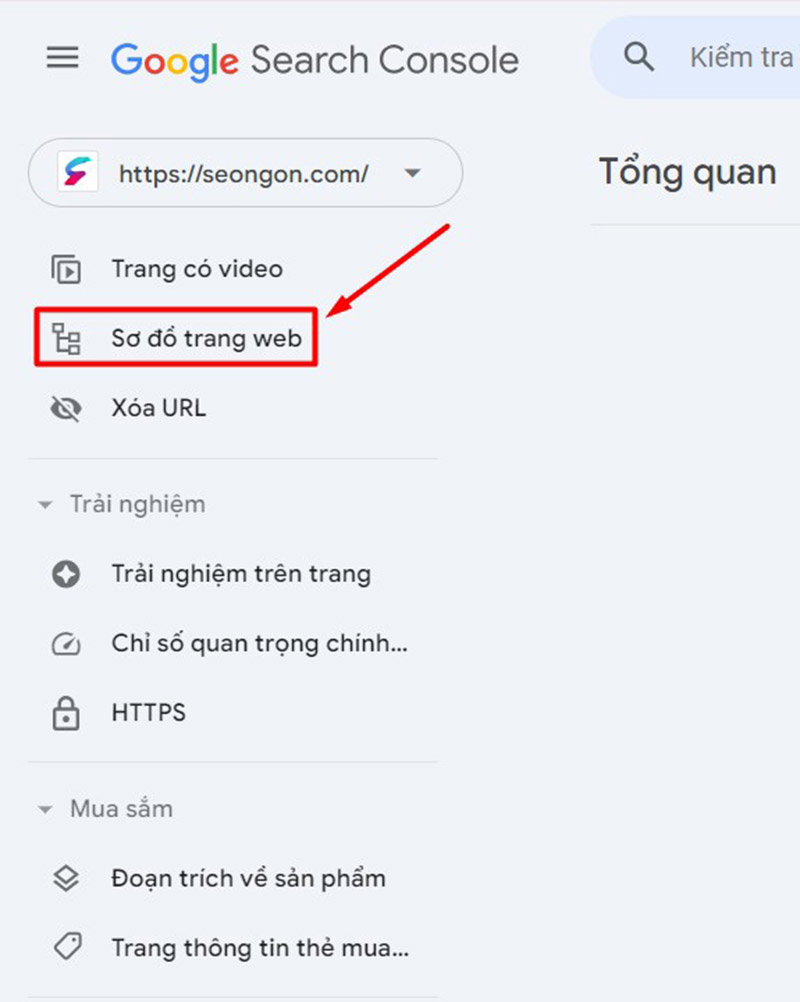

5 điểm cần check nhanh trong báo cáo Sitemaps của GSC

Mở GSC → Sitemaps. Ở đây có vài tín hiệu đủ để chẩn đoán nhanh.

- Trạng thái đọc được: Sitemap phải fetch/parse OK; gặp “couldn’t fetch/has errors” thì kiểm tra redirect, firewall/CDN chặn bot, và content-type/định dạng XML.

- Last read: Nếu lâu không được đọc lại, nghi lỗi truy cập theo thời điểm, site chậm, hoặc server giới hạn; site cập nhật thường xuyên nên thấy “Last read” đều.

- Discovered vs Submitted: Chênh lệch lớn thường do URL không hợp lệ/URL rác (param, redirect, noindex) hoặc do sitemap vừa bị tách/đổi cấu trúc khiến số liệu dao động.

- Đúng loại sitemap: Đảm bảo submit XML sitemap, không phải trang HTML sitemap cho người dùng.

- URL Inspection mẫu: Lấy vài URL trong sitemap kiểm tra nhanh; nếu dính robots/noindex/canonical khác (“Duplicate, Google chose different canonical”) thì đã rõ nguyên nhân indexed thấp.

Mẫu bảng phân loại nguyên nhân “Submitted but not indexed”

Khi tỷ lệ “Submitted” cao nhưng “Indexed” thấp, đừng xử lý theo cảm tính. Hãy phân loại theo 3 nhóm nguyên nhân. Cách làm nhanh là lấy một mẫu URL chưa indexed từ báo cáo Page indexing (hoặc URL Inspection), rồi gắn nhãn nguyên nhân.

|

Nhóm nguyên nhân |

Dấu hiệu trong GSC / URL Inspection |

Ý nghĩa thực tế |

Việc cần làm (ưu tiên) |

|

Chặn kỹ thuật: robots.txt |

“Blocked by robots.txt” |

Google không crawl được nên khó đánh giá/index |

Vị trí: robots.txt, rule generate URL, sitemap rules Nếu muốn index: bỏ rule chặn; nếu không muốn index: loại URL khỏi sitemap |

|

Chặn kỹ thuật: noindex |

“Excluded by ‘noindex’ tag” |

Trang được submit nhưng tự bảo Google không index |

Vị trí: Template/meta robots, header X-Robots-Tag Nếu muốn index: gỡ noindex; nếu không: loại khỏi sitemap |

|

Redirect / URL không ổn định |

URL Inspection thấy 301/302; hoặc sitemap URL khác URL cuối |

Google theo redirect, sitemap đang chứa URL “không chuẩn” |

Vị trí: Redirect rules, canonical policy, sitemap generation Thay URL trong sitemap bằng URL đích 200; giảm redirect chain |

|

404/410/Soft 404 |

“Not found (404)”, “Soft 404” |

Trang không tồn tại hoặc nội dung quá mỏng giống trang lỗi |

Vị trí: CMS inventory, template, nội dung, internal links 404/410: loại khỏi sitemap + fix link nội bộ; Soft 404: tăng nội dung/giá trị hoặc noindex |

|

Canonical khác / Duplicate |

“Duplicate, Google chose different canonical” / “Alternate page with proper canonical tag” |

Google chọn URL khác làm bản chuẩn |

Vị trí: Canonical tags, param handling, faceted nav rules Đồng bộ canonical; bỏ biến thể URL; sitemap chỉ chứa canonical cuối |

|

Trùng lặp do tham số/filter |

Nhiều URL cùng nội dung, khác ?sort=, ?filter= |

Index bloat/crawl waste; Google bỏ qua phần lớn |

Vị trí: Faceted nav, parameter rules, sitemap filters Chặn index biến thể; chuẩn hóa canonical; loại khỏi sitemap |

|

Được crawl nhưng chưa index |

“Crawled – currently not indexed” |

Google đã crawl nhưng chưa thấy đủ giá trị/ưu tiên |

Vị trí: Content, internal linking, template, structured data Tăng độ hữu ích, cải thiện internal link, E-E-A-T, giảm trùng lặp |

|

Discovered – currently not indexed |

“Discovered – currently not indexed” |

Google biết URL nhưng chưa crawl hoặc crawl ít |

Vị trí: IA/internal link, sitemap sạch, server performance Tăng internal links, giảm URL rác, tối ưu crawl budget, kiểm tra server |

|

Bị giới hạn bởi chất lượng site |

Nhiều URL cùng trạng thái “not indexed”; site mới/ít authority |

Google ưu tiên crawl/index thấp |

Vị trí: Content strategy, link building, technical hygiene Tập trung index nhóm trang quan trọng trước; nâng chất lượng & liên kết |

|

Chặn bởi yêu cầu đăng nhập / 403 |

401/403 khi fetch |

Bot không truy cập được nội dung |

Vị trí: Server/CDN/WAF rules Mở quyền truy cập public; whitelist bot nếu cần |

Cách xử lý lỗi sitemap và cách chia sitemap để vận hành bền vững

Dưới đây là cách xử lý sitemap theo đúng bản chất. Mục tiêu là làm cho sitemap phản ánh đúng tập URL có giá trị và có khả năng index ổn định.

Checklist URL rác cần loại khỏi sitemap ở ecommerce/listing

|

Nhóm URL rác (Dấu hiệu nhận biết) |

Bản chất vấn đề đối với Bot |

Hành động xử lý bắt buộc |

|

URL tham số bộ lọc (Chứa ?filter=, ?sort=, ?price=) |

Sinh ra hàng ngàn biến thể trùng lặp nội dung (Duplicate Content), làm loãng URL gốc. |

Loại bỏ hoàn toàn khỏi Sitemap. Chỉ giữ lại 1 URL danh mục chuẩn (Canonical URL). |

|

URL Tracking / Đo lường (Chứa utm_source, gclid, fbclid) |

Nội dung giống hệt trang gốc, khiến Google bối rối trong việc chọn trang đích chuẩn để xếp hạng. |

Tuyệt đối không đưa vào Sitemap. |

|

URL phiên truy cập (Session) (Chứa ?session=, ?sid=, lang=) |

Tự động nhân bản URL vô hạn cho cùng một nội dung bài viết/sản phẩm theo từng người dùng. |

Chuẩn hóa CMS về URL gốc. Xóa mọi biến thể Session ra khỏi hệ thống Sitemap. |

|

URL tìm kiếm nội bộ (Dạng /search?q=…) |

Nội dung động, chất lượng mỏng. Dễ bị lợi dụng để bơm từ khóa rác (Search Results Spam). |

Chặn noindex hoặc chặn trong robots.txt. Loại bỏ 100% khỏi Sitemap. |

|

URL phân trang & Tag mỏng (Dạng ?page=2&sort=…, /tag/…) |

Gây lãng phí tài nguyên cào dữ liệu (Crawl Waste) nếu số lượng quá lớn và nội dung không có nhu cầu tìm kiếm. |

Chỉ giữ URL phân trang gốc. Với Tag, chỉ đưa vào Sitemap các Tag đã được tuyển chọn nội dung kỹ lưỡng. |

|

URL lỗi hoặc bị chặn (Mã lỗi 3xx, 4xx, 5xx, Noindex) |

Báo hiệu cho Googlebot cào những trang không tồn tại hoặc không cho phép index. |

Rà soát và xóa ngay lập tức. Sitemap chỉ được chứa URL trả mã HTTP 200 (Thành công). |

Cách chia sitemap theo loại trang để dễ debug và monitoring

Cách chia phổ biến và dễ vận hành nhất là theo loại trang. Ví dụ website bán hàng có thể chia product-sitemap.xml, category-sitemap.xml, blog-sitemap.xml. Website tin tức có thể chia theo chuyên mục hoặc theo thời gian (nhóm bài mới). Site listing có thể chia theo khu vực địa lý hoặc theo loại listing.

Khi đã tách, mỗi sitemap phải có quy tắc URL rõ ràng. Ví dụ product-sitemap chỉ chứa URL canonical của sản phẩm đang public và indexable. Nếu sản phẩm hết hàng nhưng vẫn muốn giữ trang vì có traffic, vẫn có thể để indexable. Nếu sản phẩm bị xóa, trả 404 hoặc redirect, phải loại khỏi sitemap để tránh làm bẩn inventory.

Với site rất lớn, sitemap index là lớp điều phối. Nó trỏ tới các sitemap con và giúp Google tìm thấy toàn bộ tập sitemap. Nó cũng giúp đội vận hành theo dõi từng nhóm trong GSC. Khi thấy category-sitemap indexed tụt mạnh còn product-sitemap ổn định, bạn khoanh vùng được vấn đề nhanh hơn nhiều.

Fix lỗi phổ biến: đọc không được, sai định dạng, sitemap trả redirect

Khi Google Search Console (GSC) báo lỗi trạng thái sitemap (“Couldn’t fetch” hoặc “Has errors”), đừng vội thay đổi cấu trúc URL. Hãy tuân thủ nghiêm ngặt quy trình xử lý “từ ngoài vào trong” dưới đây:

- Bước 1: Chẩn đoán HTTP Status Code Đảm bảo đường dẫn (URL) của chính file sitemap đang trả về mã trạng thái HTTP 200 (Thành công). Tuyệt đối không để sitemap rơi vào trạng thái lỗi máy chủ (5xx) hoặc không tìm thấy (4xx).

- Bước 2: Gỡ lỗi chuỗi chuyển hướng (Redirect 301/302) Nếu sitemap đang bị chuyển hướng, hãy cố định 1 URL sitemap gốc duy nhất. Bạn phải submit đúng URL đích cuối cùng đó vào GSC để tránh tạo ra chuỗi chuyển hướng (redirect chain) làm lãng phí Crawl Budget.

- Bước 3: Gỡ lỗi rào cản truy cập (401/403) Nếu GSC báo lỗi không thể truy cập (lúc được lúc không), nguyên nhân thường nằm ở máy chủ. Hãy kiểm tra lại cấu hình Tường lửa (WAF), CDN hoặc tính năng giới hạn tần suất (Rate Limit) của Server. Đảm bảo IP của Googlebot đã được đưa vào danh sách trắng (whitelist) và không bị chặn bởi yêu cầu đăng nhập.

- Bước 4: Kiểm tra tính hợp lệ của định dạng XML Nếu GSC báo “sai định dạng” (Parsing error), hãy xác nhận lại tệp bạn submit chắc chắn là thẻ XML hợp lệ (không phải trang HTML cho người dùng). Đồng thời, kiểm tra Content-Type của máy chủ trả về phải là application/xml hoặc text/xml.

- Bước 5: Rà soát mẫu URL và Gửi lại (Resubmit) Trước khi bấm gửi lại, hãy lấy ngẫu nhiên một vài URL bên trong sitemap để kiểm tra lại lần cuối: Đảm bảo chúng là bản chuẩn (canonical), trả mã 200, không dính thẻ noindex hay bị chặn bởi robots.txt. Sau khi chắc chắn “sạch”, hãy resubmit trong GSC và theo dõi sự thay đổi của các chỉ số: Status, Last read, Submitted vs Indexed.

Một thói quen nhỏ nhưng mang lại hiệu quả quản trị khổng lồ là giữ Changelog (Nhật ký thay đổi) cho các rule sinh Sitemap. Khi tỷ lệ indexed đột ngột tụt giảm, bạn sẽ không phải đoán mò mà có thể truy vết ngay lập tức (Ví dụ: Tuần trước vừa đổi rule canonical, hoặc hôm qua vừa vô tình mở index cho các trang tìm kiếm nội bộ).

Khi cần tối ưu chuyên sâu, bạn có thể kết hợp phân tích Log Server để xem thực tế Googlebot đang lãng phí tài nguyên vào đâu. Tuy nhiên, trong 90% các trường hợp, bạn chỉ cần làm đúng công thức: “Sitemap sạch + Rule URL chuẩn + Theo dõi GSC theo từng nhóm” là đã giải quyết triệt để vấn đề lập chỉ mục.

Hiểu đúng sitemap và làm đúng URL inventory là cách bền nhất để tăng tỷ lệ indexed trong chiến lược SEO tổng thể của bạn. Nếu bạn muốn kiểm tra nhanh sitemap hiện tại đang sạch hay đang kéo crawl vào URL rác, đội ngũ Seo Việt có thể audit theo GSC và rule sinh sitemap, rồi đề xuất hướng xử lý phù hợp. Chỉ cần bắt đầu từ một checklist đúng, phần còn lại sẽ rõ ràng hơn rất nhiều.

Tôi là Lê Hưng, là Founder và CEO của SEO VIỆT, với hơn 14 năm kinh nghiệm trong lĩnh vực SEO. Dưới sự lãnh đạo của tôi, SEO VIỆT đã xây dựng uy tín vững chắc và trở thành đối tác tin cậy của nhiều doanh nghiệp. Tôi còn tích cực chia sẻ kiến thức và tổ chức các sự kiện quan trọng, đóng góp vào sự phát triển của cộng đồng SEO tại Việt Nam.

Bài viết liên quan

Keyword Stuffing là gì? Định nghĩa chuẩn xác nhất trong SEO.

Keyword Stuffing là việc lặp lại nhiều lần từ khóa trong nội dung bài viết...

Phân Biệt SEO và SEM? Điểm Giống Nhau & Điểm Khác Biệt

SEO và SEM là hai thuật ngữ trong Digital Marketing được sử dụng phổ biến....

Keyword mapping là gì? Cách lập bản đồ từ khóa cho người mới

Keyword Mapping là thuật ngữ không còn quá xa lạ với các SEOer chuyên nghiệp...

KPI SEO là gì? Cách xác định chỉ số và số liệu để đo lường

SEO không chỉ là đưa website lên top Google mà còn là quá trình đo...

Cấu trúc Silo là gì? Hướng dẫn thiết lập Silo Structure cho Website

Bạn đã bao giờ rơi vào tình trạng: Đổ hàng đống tiền viết hàng trăm...

Hướng dẫn đổi tên miền Website giữ nguyên Traffic & Thứ hạng SEO

Quyết định đổi tên miền luôn đi kèm với sự lo lắng tột độ. Chúng...

Semantic Search là gì? Cẩm nang Tối ưu Tìm kiếm Ngữ nghĩa trong SEO

Kỷ nguyên của những bài viết nhồi nhét từ khóa một cách máy móc đã...

Topic Cluster là gì? Cách triển khai Topic Cluster hiệu quả

Topic Cluster không chỉ là kỹ thuật nhóm bài viết mà là phương thức xây...

Lỗi 404 Not Found là gì? 6 nguyên nhân và quy trình xử lý

Nếu bạn từng lướt web và bắt gặp thông báo “404 Not Found”, chắc hẳn...