Mọi chiến lược SEO đều có thể gặp vấn đề Google không crawl đủ, index không ổn định, hoặc hiểu sai URL quan trọng. Khi đó, viết thêm bài hay xây thêm liên kết thường không giải quyết tận gốc. Technical SEO chính là phần xử lý đúng những điểm nghẽn này bằng cấu hình và cấu trúc website. Bài viết này sẽ giúp bạn hiểu rõ Technical SEO tác động thế nào đến việc lập chỉ mục và 5 hạng mục quan trọng nhất để triển khai tổng quan lên website.

Tác động của Technical SEO đến khả năng lập chỉ mục

Google không index tất cả mọi thứ theo cách đồng đều mà phân bổ tài nguyên crawl bao nhiêu, lưu ở đâu, làm mới (refresh) với tần suất nào. Vì thế mới có hiện tượng có trang đăng lên vài phút đã xuất hiện, có trang vài ngày vẫn chập chờn. Trong vận hành, bạn có thể hình dung việc lưu trữ và phục vụ dữ liệu theo “tầng” (Indexing Tiers).

- Tier 1 (nhanh) thường gắn với nội dung được hệ thống đánh giá là hữu ích, được truy cập, được liên kết tốt, và đáng để làm mới thường xuyên.

- Tier 3 (chậm) là nhóm nội dung ít tín hiệu, ít nhu cầu, nhiều trùng lặp hoặc khó crawl, nên bị ghé thăm thưa và cập nhật chậm.

Đây là cách diễn giải theo logic phân bổ tài nguyên (không phải tên gọi chính thức trong tài liệu công khai), nhưng hữu ích để ra quyết định.

Technical SEO là phần SEO tập trung vào hạ tầng và cấu trúc kỹ thuật của website, đóng vai trò tạo điều kiện để Google:

- Crawl đúng phần cần crawl (Crawl Budget),

- Hiểu đúng URL chuẩn (canonical/redirect),

- Thấy đúng nội dung (rendering + semantic HTML),

- Đánh giá trang quan trọng là “đáng ưu tiên” (utility).

Khi khâu crawl/index bị nghẽn, làm thêm SEO Onpage hay đẩy SEO Offpage thường sẽ cải thiện chậm vì Google chưa nhìn đúng trang cần xếp hạng.

Caffeine: vì sao index gần như thời gian thực và độ trễ giữa data center

Google có thể index gần thời gian thực nhờ kiến trúc lập chỉ mục kiểu Caffeine (một hệ thống index hiện đại, hướng tới cập nhật liên tục). Thay vì đợi gom dữ liệu theo “đợt lớn”, hệ thống có thể cập nhật theo dòng (stream) và làm mới nhiều phần nhỏ thường xuyên hơn.

Tuy vậy, độ trễ vẫn xảy ra vì dữ liệu cần được đồng bộ và phân phối qua nhiều cụm hạ tầng và data center. Kết quả có thể thấy cùng một truy vấn, ở thời điểm rất gần nhau, kết quả hiển thị khác chút; hoặc trang đã “thấy index” ở một nơi nhưng nơi khác chưa cập nhật.

Utility Score và E-E-A-T: lý do trang trụ cột cần “đáng để ưu tiên”

Khi Google phân bổ tài nguyên crawl và lưu trữ nhanh, logic cốt lõi thường xoay quanh “utility” (mức hữu ích/giá trị sử dụng). Trang trụ cột (pillar) hoặc trang tạo doanh thu (category/product/service) muốn vào nhóm được làm mới nhanh thì cần hai thứ:

- Tín hiệu rõ ràng rằng trang là trung tâm của chủ đề: cấu trúc nội bộ, liên kết nội bộ, URL chuẩn, không trùng lặp.

- Tín hiệu tin cậy mạnh (E-E-A-T): tác giả/đơn vị đứng sau nội dung, thông tin doanh nghiệp, nguồn tham chiếu khi cần, độ nhất quán thương hiệu, và lịch sử nội dung.

Technical SEO giúp các tín hiệu E-E-A-T được nhìn thấy đúng và dồn tín hiệu về đúng URL. Khi canonical sai, site tạo hàng loạt URL trùng lặp, hoặc bot không render thấy nội dung thật, mọi tín hiệu tin cậy cũng bị loãng. Một website dùng HTTPS ổn định, không có mã độc và có cấu trúc dữ liệu minh bạch sẽ có Trust Score cao hơn, giúp rút ngắn thời gian chờ đợi trong hàng đợi lập chỉ mục.

6 hạng mục Technical SEO giúp nâng uy tín cho website và tối ưu tốc độ index

Trong xây dựng chiến lược SEO, 6 hạng mục Technical SEO dưới đây có thể áp dụng cho phần lớn website, từ site dịch vụ nhỏ tới ecommerce và publisher lớn.

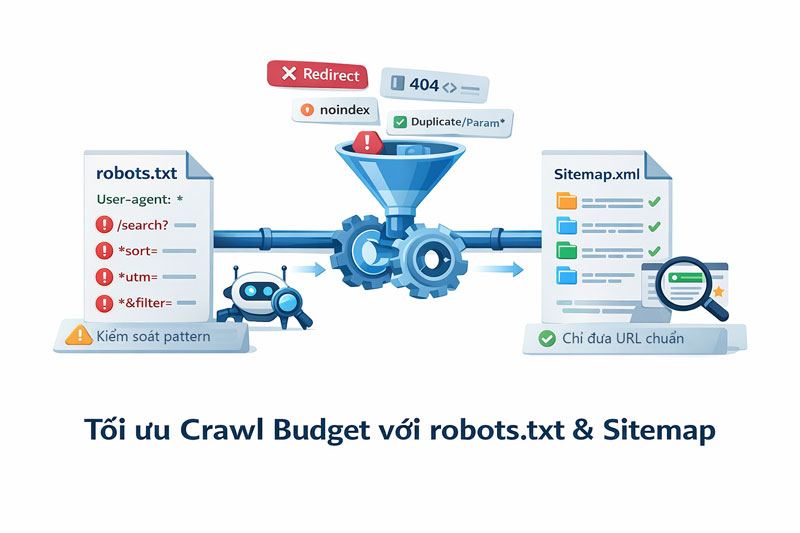

1. Cách cấu hình robots.txt và Sitemap loại bỏ nhiễu và tối ưu Crawl Budget

Crawl Budget (ngân sách thu thập dữ liệu) không phải khái niệm chỉ dành cho site cực lớn. Ngay cả site vài nghìn URL vẫn có thể đốt crawl vào nơi không tạo giá trị: trang lọc/sắp xếp vô hạn, trang tìm kiếm nội bộ, URL gắn tham số tracking, hoặc các biến thể URL do cấu hình sai.

Robots.txt nên được dùng theo hướng kiểm soát pattern gây lãng phí. Trọng tâm là chặn đúng những vùng tạo URL vô hạn hoặc không có giá trị tìm kiếm, ví dụ internal search, trang lọc có thể sinh ra hàng chục nghìn biến thể, hoặc endpoint kỹ thuật không nên index. Đồng thời, tránh chặn nhầm tài nguyên cần thiết cho rendering nếu website dùng JavaScript nhiều; bot không tải được JS/CSS quan trọng có thể khiến trang bị nhìn như “rỗng”.

Sitemap là công cụ ưu tiên mạnh hơn nhiều người nghĩ. Một sitemap tốt không cần liệt kê tất cả. Nó cần liệt kê URL canonical, indexable, trả 200 ổn định, ưu tiên trang trụ cột và trang tiền. Với site có nhiều loại trang, tách sitemap theo loại (pillar/article/category/product) giúp theo dõi submitted vs indexed dễ hơn và giúp bạn nhìn ra nhóm trang nào đang bị kẹt Tier chậm.

Nguyên tắc cần nhớ: nếu sitemap chứa nhiều URL không index được (noindex, redirect, 404, duplicate), bạn đang gửi tín hiệu sai về danh sách ưu tiên. Bot sẽ mất công, còn trang quan trọng bị giảm tần suất ghé thăm.

Với các website lớn (>10.000 URL), việc quản lý Crawl Budget là sống còn. Hãy sử dụng cấu trúc Silo và kỹ thuật Internal Link Sculpting để điều hướng Bot vào các trang ‘tiền tuyến’ (Money Pages). Một nghiên cứu của Botify cho thấy Googlebot chỉ quét qua khoảng 40% – 60% nội dung của một website thương mại điện tử trung bình. Việc tối ưu hóa tệp nhật ký (Log File Analysis) giúp bạn phát hiện ra các ‘Crawl Trap’ (bẫy thu thập) đang ngốn tài nguyên vô ích.

2. Xác định Thực thể qua Schema Markup

Trong Technical SEO, nếu robots.txt hay Sitemap là bản đồ dẫn đường, thì Schema Markup (Dữ liệu cấu trúc) chính là “Căn cước công dân” để Google xác thực độ uy tín của website. Google sử dụng các Semantic Triples (Bộ ba thực thể: Chủ thể – Quan hệ – Đối tượng) để xây dựng Knowledge Graph. Khi bạn khai báo Schema, bạn đang trực tiếp giúp Google xác nhận các thực thể này mà không cần thuật toán phải “đoán”.

Để tăng độ uy tín và được index nhanh vào Tier 1, bạn cần tập trung vào 3 loại Schema cốt lõi sau:

1. Organization Schema (Xác thực doanh nghiệp)

Đây là cách bạn khẳng định với Google rằng website này thuộc về một tổ chức có thật, có địa chỉ và thương hiệu rõ ràng. Giúp hiển thị Knowledge Panel (Bảng tri thức) bên phải kết quả tìm kiếm, tăng 80% độ tin cậy trong mắt người dùng và bot.

2. Person Schema (Xác thực tác giả – E-E-A-T)

Google đánh giá cao nội dung được viết bởi các chuyên gia có danh tiếng. Schema Person giúp kết nối bài viết với danh tiếng thực tế của tác giả. Bạn cần khai báo tên tác giả, chức danh, và sử dụng thuộc tính sameAs để trỏ về profile LinkedIn, Wikipedia hoặc các bài báo mà tác giả đã từng xuất hiện.

3. Article & Breadcrumb Schema (Tối ưu cấu trúc nội dung)

- Article Schema: Khai báo rõ ngày xuất bản (datePublished) và ngày cập nhật (dateModified). Việc này cực kỳ quan trọng cho tiêu chí “index nhanh”, vì Google sẽ ưu tiên cào lại các trang có dấu mốc thời gian mới.

- BreadcrumbList Schema: Giúp Google hiểu phân tầng của website, từ đó phân bổ Utility Score (điểm hữu ích) từ trang chủ xuống các trang chuyên sâu một cách mạch lạc.

Đừng chỉ cài đặt Schema bằng plugin một cách tự động. Hãy sử dụng công cụ Rich Results Test của Google để kiểm tra xem các “mối quan hệ” giữa các thực thể đã được thiết lập chính xác chưa. Một bộ Schema bị lỗi còn tệ hại hơn việc không có Schema, vì nó gửi đi những tín hiệu mâu thuẫn về thực thể của bạn.

3. Chuẩn hoá URL để gom tín hiệu về một trang Tier 1

Muốn một trang rơi vào Tier nhanh, trước hết nó phải là một trang duy nhất trong mắt hệ thống. Trùng lặp URL là lý do phổ biến làm pillar bị loãng: cùng nội dung nhưng có biến thể http/https, www/non-www, có/không dấu “/” cuối, hoặc gắn UTM/param. Khi đó, tín hiệu liên kết và tín hiệu người dùng bị phân tán, Google cũng khó chọn đúng bản chính.

Phân biệt 2 công cụ Canonical và redirect:

- Canonical dùng khi bạn có nhiều URL tương tự, nhưng vẫn cần tồn tại vì lý do trải nghiệm hoặc hệ thống. Mục tiêu là nói rõ “URL chuẩn là cái nào”.

- Redirect 301 dùng khi URL cũ không còn giá trị và bạn muốn chuyển vĩnh viễn sang URL mới. Redirect chain (A→B→C) làm bot tốn tài nguyên và làm tín hiệu yếu đi theo thời gian.

Với ecommerce, quản trị tham số và faceted navigation là bài toán sống còn. Nếu filter/sort tạo ra vô hạn URL index được, site sẽ phình ra thành một rừng duplicate. Khi đó, các trang category/pillar có thể rơi vào nhóm crawl thưa vì hệ thống phải chia tài nguyên cho quá nhiều URL na ná nhau.

Technical SEO ở đây là đặt quy tắc: loại filter nào đáng index (có nhu cầu tìm kiếm, có inventory ổn, nội dung hữu ích), loại nào chỉ nên tồn tại phục vụ người dùng nội bộ.

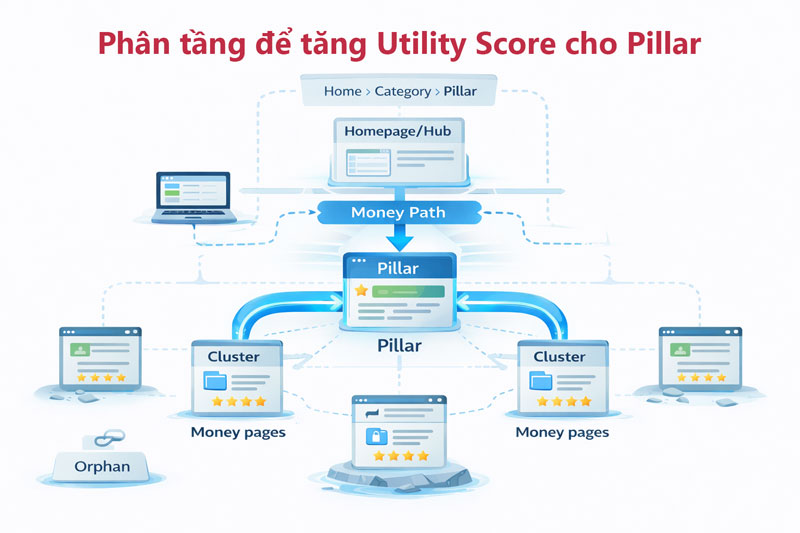

4. Internal link và phân tầng để tăng Utility Score cho Pillar

Nhìn vào thực tế: Google hiểu website theo đường link. Trang nào được trỏ tới rõ ràng, nằm trong cấu trúc phân tầng mạch lạc, và được nhắc đến đúng ngữ cảnh, thường được đánh giá là quan trọng hơn.

Pillar muốn được ưu tiên phải nằm trên “money path”: từ homepage hoặc hub, đi xuống pillar, rồi sang các cụm nội dung (cluster) và trang chuyển đổi. Nếu pillar bị đẩy sâu quá nhiều lớp, hoặc các trang cluster không trỏ ngược về pillar, tín hiệu trung tâm bị yếu.

Breadcrumb vừa giúp người đọc định hướng, vừa giúp bot hiểu phân tầng. Với site lớn, BreadcrumbList schema còn giúp hệ thống đọc cấu trúc rõ hơn. Nhưng schema chỉ có ý nghĩa khi kiến trúc thật sự hợp lý; không có internal linking, schema không tự tạo ra sức mạnh.

Một sai lầm phổ biến là để nhiều trang quan trọng lại bị “mồ côi” (orphan pages): có trong sitemap hoặc được submit, nhưng gần như không có link nội bộ. Những trang này thường khó vào nhóm được refresh nhanh, vì hệ thống không thấy chúng là nút quan trọng trong mạng lưới website.

5. Rendering và Semantic HTML để Google index nhanh

Website càng phụ thuộc JavaScript thì rủi ro càng tập trung vào việc Googlebot có nhìn thấy nội dung chính và liên kết chính ngay khi crawl không. Nếu bot chỉ thấy một khung rỗng chờ hydrate, hoặc thấy trạng thái “không có dữ liệu” trước rồi mới đổi nội dung sau khi chạy JS, trang dễ rơi vào nhóm bị crawl thưa và index không ổn định.

Với site JS-heavy, ưu tiên kỹ thuật thường nằm ở SSR (server-side rendering) hoặc một dạng HTML snapshot đủ để bot đọc được nội dung chính ngay từ response đầu. Hydration vẫn có thể xảy ra sau đó để phục vụ trải nghiệm người dùng, nhưng phần quan trọng là: tiêu đề, đoạn mở đầu, nội dung chính, internal links và breadcrumb nên tồn tại ở HTML crawlable, không phụ thuộc hoàn toàn vào JS event hay API call chạy muộn. Hãy đảm bảo các thông tin xác thực (footer, địa chỉ, chứng nhận) luôn có trong bản HTML tĩnh để Googlebot xác minh ngay lập tức.

Semantic HTML cũng là một đòn bẩy bị xem nhẹ. Khi dùng đúng thẻ và cấu trúc, máy đọc dễ hơn, ít phải “đoán” mục đích khối nội dung. Ví dụ, dùng header/nav/main/article/section đúng vai trò, heading theo thứ bậc rõ ràng, liên kết dạng <a href> thay vì click handler, và breadcrumb có cấu trúc ổn định. Kết quả thực tế thường thấy là index ổn định hơn, đặc biệt với pillar và hub.

Thực tế, ngay cả những website chuyên nghiệp cũng không tránh khỏi lỗi hiển thị trên mobile như bố cục vỡ, nút bấm quá nhỏ, văn bản khó đọc,… Những vấn đề này thường chỉ được phát hiện khi có người dùng phản hồi hoặc khi website đã bị Google cảnh báo.

- Tham khảo hướng dẫn chính thức từ Google tại đây: Mobile-first Indexing từ Google

- Kiểm tra mức độ thân thiện với di động của website bạn tại đây: Mobile-Friendly Test

6. Core Web Vitals để cải thiện hành vi người dùng và tần suất bot ghé thăm

Khi trang nặng, giật, hoặc phản hồi chậm, người dùng rời đi nhanh hơn và hệ thống khó duy trì trải nghiệm tốt. Với bot, trang chậm cũng làm crawl kém hiệu quả vì cùng một lượng tài nguyên, bot thu được ít nội dung hơn.

Cách làm thực dụng là tối ưu theo template quan trọng: trang chủ, pillar/hub, category, product, article. Tối ưu dàn trải toàn site thường không hiệu quả bằng việc “đánh đúng” các template tạo doanh thu hoặc tạo authority.

Lúc này, các hạng mục kỹ thuật hay gặp là giảm JS không cần thiết, tối ưu ảnh và font, kiểm soát script bên thứ ba, caching/CDN, và đặt “performance budget” cho từng template.

Tối ưu Core Web Vitals (bao gồm: tốc độ tải LCP, độ trễ tương tác INP và tính ổn định bố cục CLS) có thể giúp giảm khoảng 40% tỷ lệ thoát và tăng khả năng bot truy cập thường xuyên hơn, nếu trước đó site có trải nghiệm kém và việc tối ưu tập trung vào template mang traffic chính. Đây là ví dụ để hình dung tác động; con số thực tế phụ thuộc ngành, nguồn traffic và mức baseline.

Từ tháng 3/2024, Google đã chính thức thay thế FID bằng INP (Interaction to Next Paint). Đây là chỉ số đo lường toàn bộ độ trễ phản hồi của trang web trong suốt vòng đời của nó. Một website Technical SEO chuẩn 2026 cần đảm bảo INP dưới 200ms. Theo báo cáo của HTTP Archive 2025, các trang web tối ưu tốt chỉ số INP có tỷ lệ chuyển đổi (Conversion Rate) cao hơn 15% so với các trang có INP trên 500ms.

Trong các case study tổng hợp bởi web.dev, Nykaa cho biết LCP cải thiện 40% đi kèm +28% organic traffic từ các thành phố T2/T3. Cdiscount cải thiện các chỉ số Core Web Vitals và ghi nhận +6% revenue uplift trong dịp Black Friday.

Khi trang quan trọng tải nhanh và ổn định, hệ thống có xu hướng “tin” rằng tài nguyên bỏ ra cho crawl/render là đáng. Đây là một phần điều kiện để giữ trang quan trọng ở nhóm được làm mới đều.

Kiểm tra nhanh bằng GSC theo logic Tier 1 vs Tier 3

Nếu cần một quy trình ngắn để biết trang đang bị kẹt ở “Tier chậm” vì lý do gì, Google Search Console luôn là điểm bắt đầu tốt nhất khi trang bị kẹt ở tier 3. Mục tiêu của kiểm tra nhanh không phải tìm mọi lỗi, mà là tìm đúng loại lỗi kéo tụt khả năng crawl/index và làm Google chọn sai URL.

Cách làm hiệu quả là chọn mẫu theo template, không chọn ngẫu nhiên. Lấy vài URL pillar (trang trụ cột), vài URL cluster (bài hỗ trợ), và vài URL tiền (category/product/service). Sau đó chạy theo thứ tự: URL Inspection để xem Google thấy gì, Page indexing để biết vì sao bị loại trừ, Sitemaps để xem URL quan trọng có nằm trong danh sách ưu tiên không, rồi Core Web Vitals để nhìn theo template.

Triage lỗi indexing theo “nhóm nguyên nhân”, không theo từng URL

Trong báo cáo Page indexing, đừng fix từng URL lẻ. Hãy nhìn theo nhóm lý do và mẫu lặp theo template. Ví dụ, nếu nhiều URL bị “Duplicate” hoặc “Alternate page with proper canonical”, vấn đề thường nằm ở canonical theo template hoặc biến thể tham số.

Nếu gặp “Crawled – currently not indexed”, cần kiểm tra chất lượng/utility và xem bot có thấy nội dung thật không. Nếu “Discovered – currently not indexed”, nhiều khi site đang có quá nhiều URL để crawl, hoặc sitemap/ internal link chưa đủ mạnh để ưu tiên.

URL Inspection hữu ích ở chỗ nó cho bạn xem phiên bản mà Google nhìn thấy. Cần chú ý ba điểm:

- Google-selected canonical có trùng với canonical bạn khai báo không

- Trạng thái index hiện tại ra sao

- Phần view crawled page có đủ nội dung chính không (đặc biệt với site dùng JS).

Kiểm tra rendering và link discoverability cho site dùng JS

Nếu website dùng SSR/hydration, hãy coi rendering là bài kiểm tra bắt buộc cho các trang pillar. Nếu một trang có thiết kế rất đẹp với người dùng nhưng lại rỗng hoặc thiếu link khi bot crawl, khi đó internal link chiến lược cũng không phát huy vì bot không “thấy” liên kết trong HTML.

Cần xác nhận là: tiêu đề, đoạn mở đầu, phần nội dung chính, breadcrumb, và các liên kết nội bộ quan trọng có tồn tại trong HTML crawlable không. Nếu không, ưu tiên chuyển những phần này về render phía server hoặc đảm bảo chúng được xuất hiện sớm và ổn định, không phụ thuộc vào hành vi người dùng.

Technical SEO là nền tảng giúp website được Google crawl hiệu quả, chọn đúng URL, hiểu đúng nội dung và ưu tiên làm mới các trang quan trọng. Nếu bạn đang muốn triển khai Technical SEO theo hướng thực dụng để nâng độ ổn định indexing và giảm rủi ro sau update/deploy, có thể bắt đầu bằng kiểm tra nhanh trong GSC và ưu tiên theo 5 hạng mục trong bài.

Nếu không có nguồn lực dev hoặc cần kiểm chứng độc lập, lựa chọn dịch vụ SEO theo hướng technical audit + giám sát sau deploy thường giúp giảm rủi ro nhanh hơn. Khi cần roadmap và vận hành duy trì thứ hạng ở quy mô lớn hơn, SEO Việt có thể hỗ trợ theo mô hình SEO Tổng thể với quy trình audit → backlog → triển khai → theo dõi.

Tôi là Lê Hưng, là Founder và CEO của SEO VIỆT, với hơn 14 năm kinh nghiệm trong lĩnh vực SEO. Dưới sự lãnh đạo của tôi, SEO VIỆT đã xây dựng uy tín vững chắc và trở thành đối tác tin cậy của nhiều doanh nghiệp. Tôi còn tích cực chia sẻ kiến thức và tổ chức các sự kiện quan trọng, đóng góp vào sự phát triển của cộng đồng SEO tại Việt Nam.

Bài viết liên quan

Screaming Frog là gì? Khám phá công cụ “quốc dân” của SEOer

Nếu bạn đang tìm kiếm một công cụ mạnh mẽ để phân tích và tối...

Topic Cluster là gì? Cách triển khai Topic Cluster hiệu quả

Topic Cluster không chỉ là kỹ thuật nhóm bài viết mà là phương thức xây...

YMYL là gì? Bí quyết SEO “sống còn” cho các website YMYL

Website rớt hạng không phanh sau mỗi đợt Google Core Update, lượng traffic “bốc hơi”...

Hướng dẫn SEO Website WordPress toàn tập cách lên top Google

Bạn vừa xây dựng xong một website WordPress tuyệt đẹp, nhưng lại đang đối mặt...

Hướng dẫn cách nghiên cứu từ khóa Website đối thủ từ A-Z (Bứt phá Traffic)

Bí ý tưởng viết bài? Traffic website dậm chân tại chỗ dù bạn đã “vắt...

Hướng dẫn cách sử dụng Google Analytics 4 (GA4) từ A-Z cho người mới

Bạn đang sở hữu một trang web nhưng lại lúng túng không biết khách hàng...

Thẻ Alt là gì? Cách tối ưu thẻ Alt chuẩn SEO tăng thứ hạng

Bạn đã bao giờ tự hỏi vì sao website của mình sở hữu những hình...

Hướng dẫn trao đổi backlink hiệu quả và an toàn năm 2026

Triển khai SEO cần một lượng lớn backlink chất lượng, nhưng bài toán đặt ra...

Tổng hợp chi phí làm SEO cho doanh nghiệp và cách dự toán ngân sách

Bạn đang bối rối khi cầm trên tay hàng tá báo giá SEO với mức...